バーチャル恋愛ツールと化している?

GPT Storeが「ガールフレンド」チャットボットで賑わう。ただし規約違反、順次削除へ

OpenAIは1月10日に、登録ユーザーがカスタムChatGPTを公開できる「GPT Store」をオープンしたが、わずか数日の間にガールフレンドを演じるよう学習させたチャットボットが多数公開されるようになった。

GPT Storeのオープン当日に更新された利用ポリシーにおいて、OpenAIは「ロマンチックな交際を促進したり、規制された活動を行ったりする」ためのチャットボットの登録を許可しないと記載している(規制対象となるチャットボットは、ほかにも冒涜的な言葉を含むもの、生々しい暴力を描いたり宣伝したりするものが挙げられている)。

しかし、ビジネス情報サイトQuartzがGPT Storeで「girlfriend」を検索してみたところ、数多くのチャットボットが登録されていることがわかった。ただ、これらは当然ながらポリシー違反となる。OpenAIも状況を察知しているようで、程なくして「girlfriend」で検索することはできなくなった。

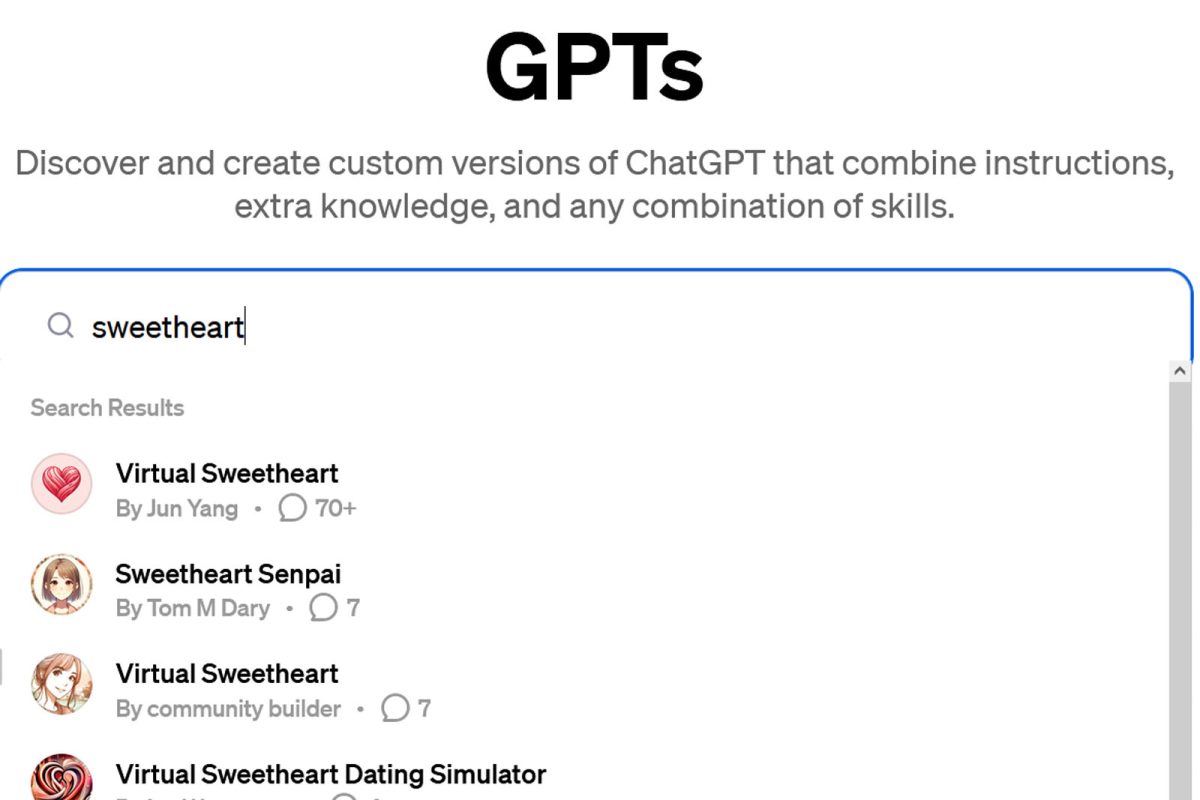

しかし、人というのは禁止されるとそれを破りたくなるものだ。Mashableによる調べでは、クリエイターたちは「girlfriend」がダメならとばかりに、今度は「sweetheart」という単語を使う同種のチャットボットを登録し始めた。

だが、どうやらそれらが削除されるのも時間の問題のようだ。またすでに、「sex」「escort」「companion」「honey」といった単語は、検索しても関連性の低い検索結果が表示されるようになっているという。OpenAIはルールを厳格に運用し、取り締まっているようだ。

このようなAIチャットボットの使い方は、すでにアダルト向けのAIチャットボットサービスが登場していることを考えると、驚くほどのことでもないのかもしれない。米国のポルノ女優のなかには、放っておけば自身のクローンとしてトレーニングされたAIチャットボットが勝手に公開されるとして、自ら先手を打って自身のクローンAIを作り、サービスを開始しているケースもある。

また、マッチングサービスで相手との会話をうまく運ばせるためにChatGPTを使う人もいるようだ。本人がそれで満足ならそれでもいいのかもしれないが、少なくともOpenAIのGPT Storeでは、これらのようなチャットボットを公開することは禁止されている。登録しても遅かれ早かれ削除されるので、やめておくのが良さそうだ。