【連載】西田宗千佳のネクストゲート 第32回

Adobe生成型AIの壮大な計画。Fireflyは「一部」に過ぎない

Adobeは3月21日(アメリカ太平洋時間)、自社開発のジェネレーティブ(生成型)AI「Adobe Firefly」を発表し、同日よりプライベートベータテストの申し込みを開始した。

この発表は、ラスベガスで開催された同社のマーケティング製品関連開発者会議「Adobe Summit 2023」で公開されたもの。同社は自社製品に対し、ジェネレーティブAIの搭載を積極展開するとしている。

ただし、Adobeの使うジェネレーティブAIは複数あり、Fireflyはその1つでしかない。それはどういうことなのか、Fireflyを実際に現地で触りながら考えた。

SenseiもジェネレーティブAIに。その下にできる「Firefly」

Adobe Fireflyは、同社がクリエイティブツールの中で共通的に使っていくジェネレーティブAIになる。同社のAIといえば「Adobe Sensei」があるが、両者は別のものだ。

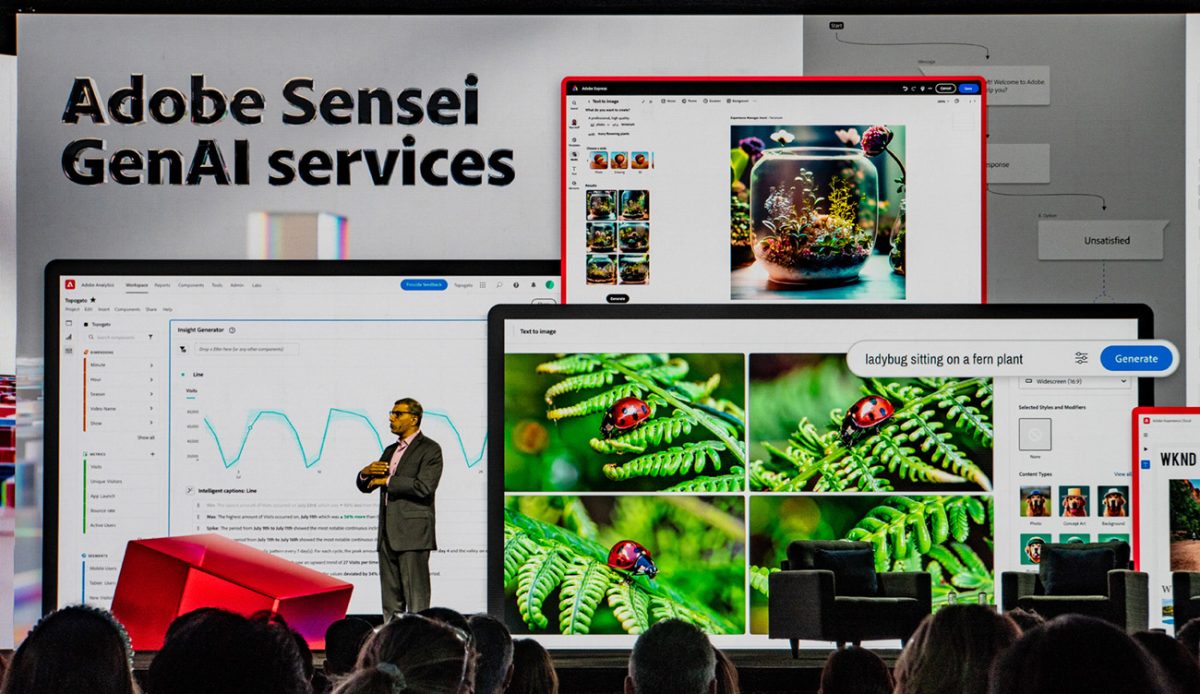

ただし、Adobe Senseiが「AdobeのAIブランドの総称」であることは変わらない。またAdobe Senseiにも、Fireflyとは別にジェネレーティブAIの搭載が発表されており、これは「Adobe Sensei Gen AI」という。その下に、特化したAIとしてFireflyがある……という感じだろうか。

なんだか分かりにくいかもしれないが、これはジェネレーティブAIに複数の役割があるから、と考えるべきだろう。

大規模言語モデルを使って、文章の命令から多くのことに使えるというのが今のジェネレーティブAIの特徴だが、分析や指示に向いた使い方と、画像などを生成するために向いた使い方とでは、連携する学習モデルに違いが出てくる。Fireflyは画像生成向けであり、もっと全般的な作業も想定したものがAdobe Sensei Gen AIというイメージだ。

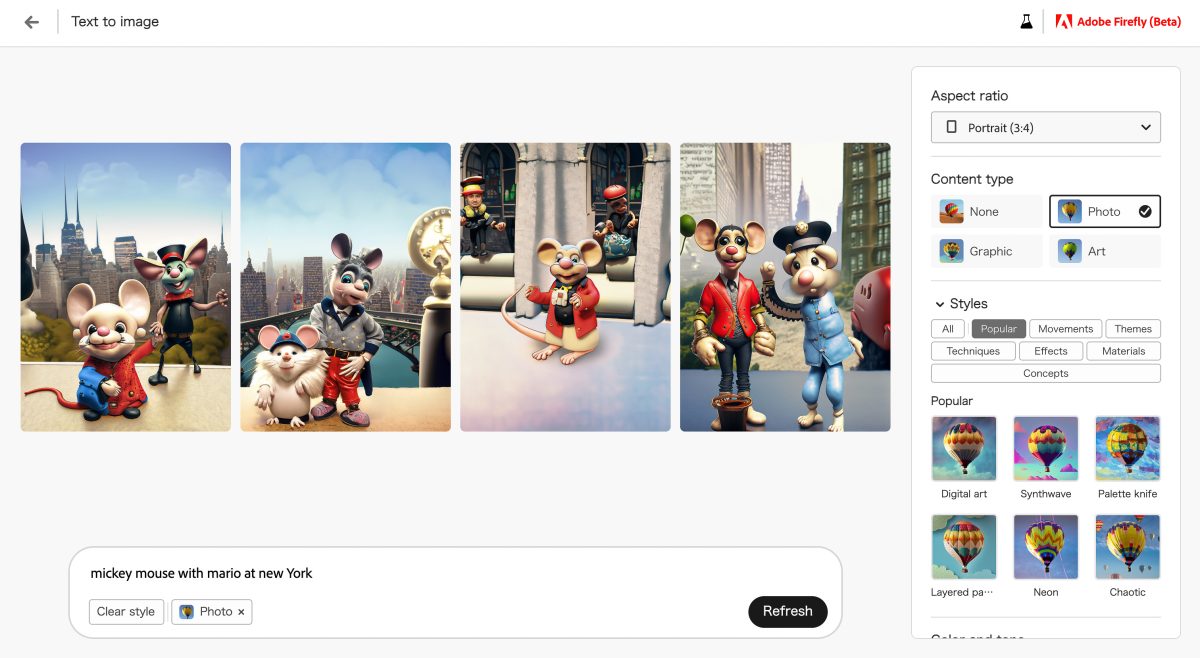

前述のようにFirefly自体は、申し込んだ人に対して少しずつ利用権を付与していく形での「クローズドベータ」中であり、開発途上のものである。そのため現在は「テキストから画像を生成」「テキストから文字へのエフェクトを生成」の2つにだけ対応していて、生成もウェブブラウザからのみ行える状況だ。

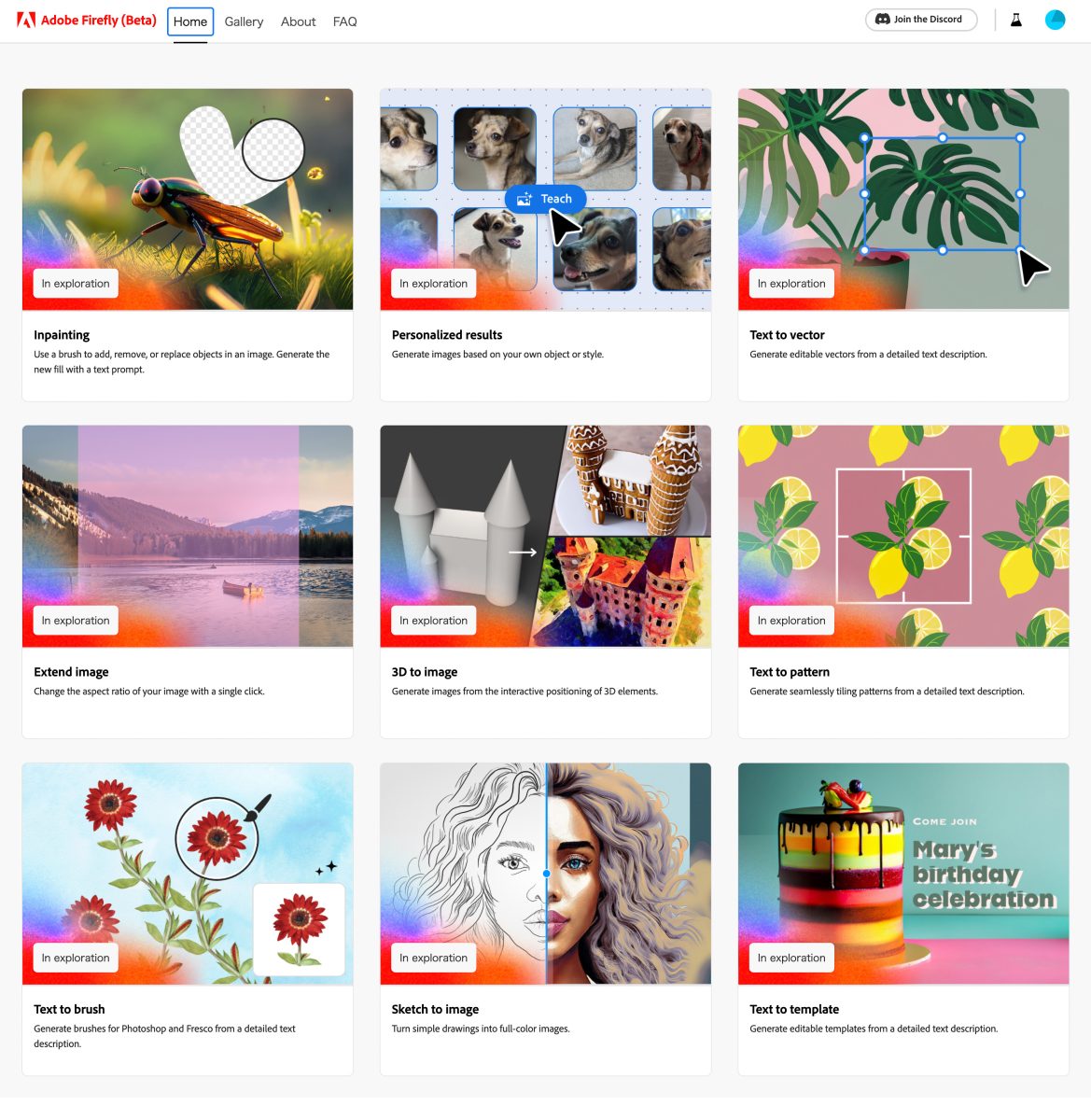

複数言語対応で開発が進んでいるものの、現状は日本語には非対応で、英語からの生成のみとなっている。この辺も「途上」のイメージが強い。とはいうものの、以下の画像に示すように、非常に多数の生成機能の実装が準備されていて、さらにPhotoshopなどの主要アプリケーションから直接利用することも想定済みだ。

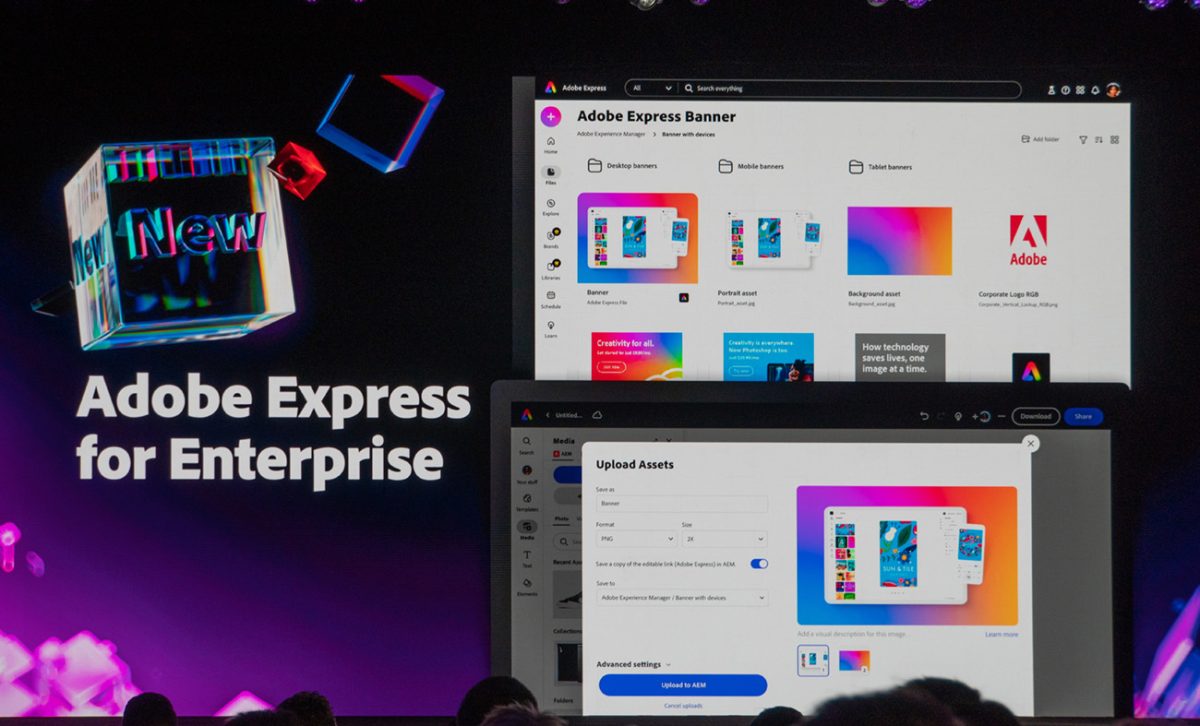

また、Adobe Summitの基調講演では、シンプルに使えるグラフィック生成ツール「Adobe Express」の企業向けバージョンである、「Adobe Express for Enterprise」に機能を組み込んだバーションも公開されている。

著作権へ配慮し「企業に使いやすい」AIに

では、Adobe FireflyはどんなジェネレーティブAIなのか。現在のクローズドベータ版を見ると、前述のように機能はシンプルだ。主に画像生成を使ってみたが、出てくる絵の質自体は、他のジェネレーティブAIと同等か、少し遅れているくらいかなと思う。

一方で面白いのは「著作権上の配慮」があることだ。たとえば、「mickey mouse with mario at new York」(ニューヨークにいるミッキーマウスとマリオ)という題材を出すと、一般的なジェネレーティブAIでは、ここに掲載するのがためらわれるような結果が出てくる。しかしFireflyでは、少なくとも「キャラクターがそのものズバリ」は出てこない。

これは単語として他社の権利に配慮しているだけでなく、「Adobe Stock」のような、権利処理が行われたデータから学習を行っているからだ。Adobe Stockには数億のコンテンツがあり、学習データとして十分な内容を持っている。

しかし、Adobe Stockにも登録時の認証をすり抜けた、グレーなコンテンツも登録されてしまってはいる。さすがにミッキーマウスはないが、100%クリアかというと、そうとは言えないかもしれない。それでも、ジェネレーティブAIで作ったコンテンツを使いたい企業から見れば、全く条件が見えないところから生成されたものよりはずっと安心できるだろう。

また、これは今後の予定ではあるが、自社で用意したロゴなどの意匠物を学習ソースに取り込んで生成する「カスタム学習」にも対応する。広告コンテンツなどのアイデアソースにAIを使うなら、そうした機能は必須だ。

ジェネレーティブAIを「生成」と「副操縦士」に

そうした目線で見るとFireflyは、かなり計画的に作られてきたAIであるのがわかる。ジェネレーティブAIへ取り組むこと自体は、去年秋に開催された「Adobe MAX 2022」でも公開されていたが、それをどう具体化するかが見えたのが、今回のキモといえる。

ただ、各クリエイティブツールへの導入はこれからだろう。別の言い方をすれば、本番はさらにあと、ひょっとしたら2023年秋のAdobe MAXで……ということになるのかもしれない。

そのような状況で、なぜこの春にAdobe Summitで発表したのかといえば、ポイントは2つある。1つは、ジェネレーティブAIをめぐる動きが速すぎるので、ここで発表しておかないと遅れてしまう、という切実な事情だ。そしてもう1つは、冒頭でも述べたように「FireflyはAdobeのジェネレーティブAIの一部分でしかない」ということにある。

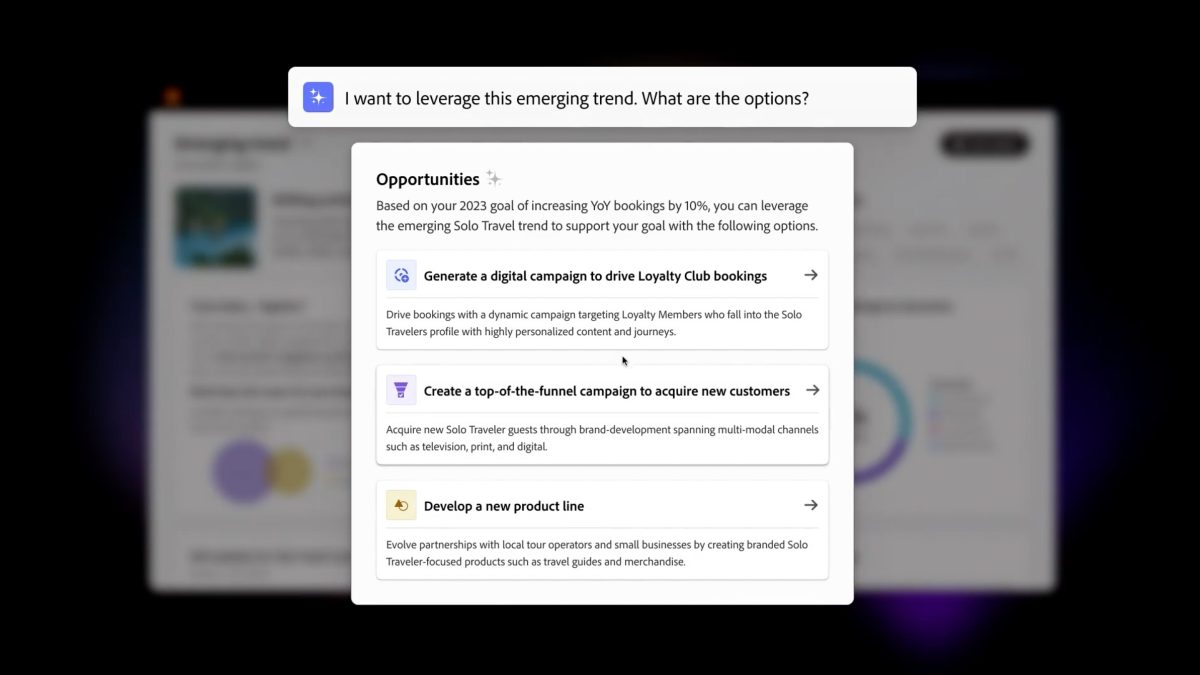

今回のAdobe Summitでは、同社のデジタルマーケティングツールである「Adobe Experience Cloud」でのAI活用が語られた。Adobe Sensei Gen AIに対し、テキストの命令で「行うべき作業」を伝え、そこから作業を自動化・高速化し、より簡単に日常的なマーケティング業務を行う姿がデモされた。

これこそが、Adobeが今アピールしたい部分そのものだ。「AIをCopilot(副操縦士)とする」という発言は、基調講演の中で何度も使われている。マイクロソフトとも共通するビジョンではあるが、逆にいえば、日常の仕事におけるツール連携や戦略分析データのとりまとめといった「面倒な仕事」は、みんなAIに押し付けて高速化したい…という共通のニーズが存在する、ということでもある。

Fireflyで作る画像はそのための素材である。Adobeは「副操縦士」と「素材生成」という2面でAI対応を進めたいと考えており、その戦略を明確に伝えるには、まさにAdobe Summitという場がベストと考えた、という話でもあるのだ。