ローカルPC上で様々なLLMが試せる

NVIDIA、AIチャットボット「ChatRTX」強化を発表。写真検索や音声認識も可能に

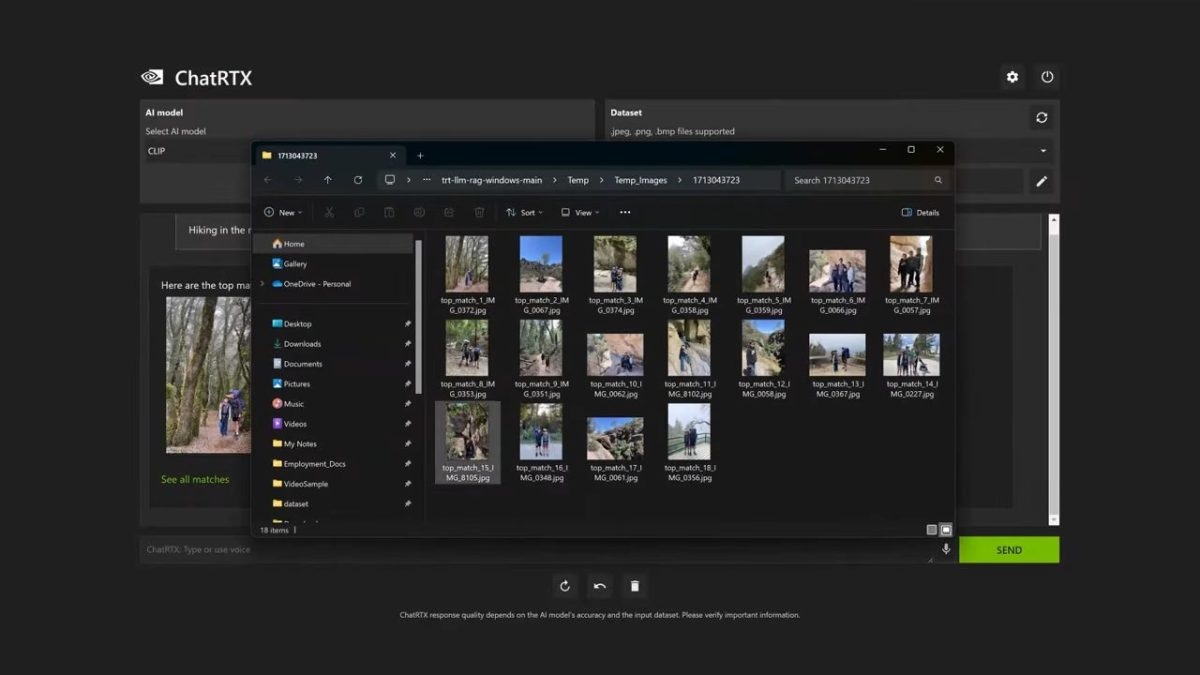

米NVIDIAは、AIチャットボット「ChatRTX」をメジャーアップデートし、より多くのLLM(大規模言語モデル)を追加した。GoogleのGemma、ChatGLM3、OpenAIのCLIP(Contrastive Language-Image Pre-training)モデルもサポートし、写真の検索や音声認識も可能となった。

すでにMistralやLlama 2などは利用できたが、対応するLLMのリストが拡張された。3月のGTCで予告していた新機能が、ようやく一般ユーザーに開放された格好である。

ChatRTXとは、独自のコンテンツ(ドキュメントやメモ、その他のデータ)に接続されたGPT LLMをカスタマイズできるデモアプリだ。同社のRTX 30シリーズまたは40シリーズGPU(VRAM 8GB以上)を搭載したWindows PCやワークステーションのローカル上で実行可能なため、迅速かつ安全に結果が得られる。

GoogleのGemmaは、Geminiモデルと同じ技術を使いながらも、強力なノート/デスクトップPC上で動作するよう設計されているため、ChatRTXへの搭載は適切だ。

また一般的な言語モデルフレームワークに基づいた、オープンでバイリンガル(英語と中国語)のLLMであるChatGLM3にも対応した。NVIDIA製のアプリは、これら複数のモデルをローカルで実行する際の煩雑さを軽減してくれる。

具体的にはRTXカードをNASに入れてローカルサーバーとし、他のPCからブラウザ経由でアクセスできる。そうして利用の敷居が下がることで、様々なLLMを試した上で、自分が分析や検索したいデータに最適なモデルを見つけやすくなるだろう。

またOpenAIのCLIPモデルを追加したことで、従来は必要だった複雑なメタデータのラベリングなしに、単語やフレーズにより写真や画像が検索できる。さらにAI音声認識システムWhisperも統合され、ユーザーは自らのデータと音声で “会話” が可能となっている。

今回のアップデートは、決して安価とは言えないNVIDIAのGPUを買う必要があるとはいえ、様々なLLMを試して日常的に活用するきっかけとなりそうだ。

- Source: NVIDIA